O relator do projeto de lei que regulamenta a inteligência artificial (IA) no Brasil excluiu, nesta terça-feira (3), o dispositivo que considerava como sendo de alto risco os sistemas de IA usados pelas plataformas digitais, as chamadas big techs, para produção, análise, recomendação e distribuição de conteúdos.

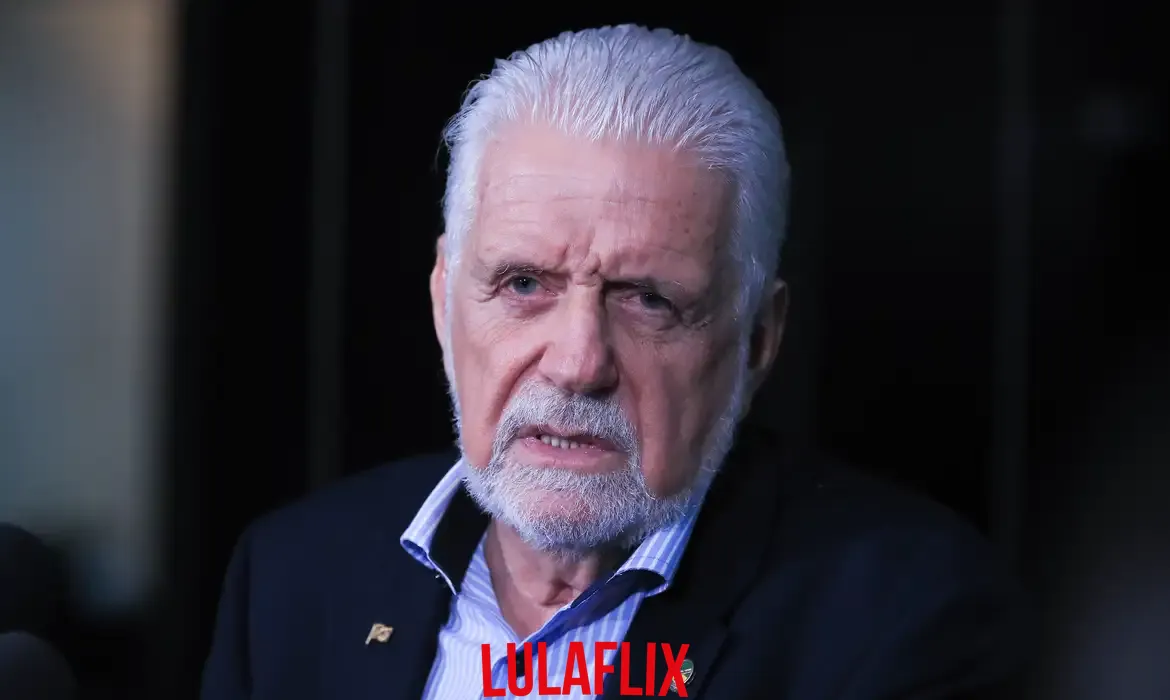

São considerados de alto risco os sistemas de IA que podem causar danos às pessoas ou à sociedade. De acordo com o relator, senador Eduardo Gomes (PL-TO), a retirada desse trecho foi um acordo entre as bancadas para fazer o texto avançar na Comissão Especial do Senado criada para analisar o tema.

O projeto de lei 2.338 de 2023, de autoria do presidente do Senado, Rodrigo Pacheco (PSD-MG), determina que sistemas de IA considerados de alto risco devem ser submetidos a regras mais rígidas de governança, monitoramento e fiscalização.

O texto define como de alto risco uma série de casos, entre eles, os sistemas de inteligência artificial que impactam na saúde e segurança das pessoas, como no diagnóstico médico, ou os que podem ser usados para seleção de trabalhadores em empregos, para a seleção de estudantes em instituição de ensino ou no atendimento de serviços públicos.

O trecho que se referia às big techs afirmava que seria considerada uma IA de alto risco o sistema de “produção, curadoria, difusão, recomendação e distribuição, em grande escala e significativamente automatizada, de conteúdo por provedores de aplicação, com objetivo de maximização do tempo de uso e engajamento das pessoas ou grupos afetados”.

A coordenadora de incidência da organização Repórteres Sem Fronteiras na América Latina, Bia Barbosa, que tem pressionado para a aprovação do projeto, avaliou que o trecho foi retirado por pressão das plataformas digitais.

“Não faz nenhum sentido um projeto de lei de regulação de IA que não trate dos sistemas de recomendação e moderação de conteúdo, que são sistemas de alto risco. Só que as plataformas, assim como fazem em todos os países do mundo, se opõem de maneira significativa a qualquer regulação que venha afetar os seus negócios e, aqui no Brasil, elas têm um aliado muito significativo, que são os parlamentares de extrema-direita”, destacou a especialista.

Barbosa citou a desinformação em massa em eleições, na pandemia de covid-19 e os ataques à democracia por meio das redes sociais como exemplos de danos que os sistemas de recomendação de conteúdos via IA das plataformas podem causar às pessoas e à sociedade.

Apesar dessa mudança, foi adiada para a próxima quinta-feira (5) a votação do projeto na Comissão. Havia a expectativa de que o tema fosse aprovado nesta terça-feira. O adiamento ocorreu porque não houve consenso entre os parlamentares em relação aos trechos que exigem a integridade da informação para sistemas de IA.

Projeto

O projeto que regulamenta a inteligência artificial no Brasil também estabelece os princípios fundamentais para o desenvolvimento e uso de IA. Ele define que a tecnologia deve ser transparente, segura, confiável, ética, livre de vieses discriminatórios, respeitando os direitos humanos e valores democráticos. O projeto exige também que sejam contemplados o desenvolvimento tecnológico, a inovação, a livre iniciativa e a livre concorrência.

Além de enumerar os sistemas de IA considerados de alto risco, o projeto proíbe o desenvolvimento de alguns tipos de tecnologias de IA que causem danos à saúde, à segurança ou a outros direitos fundamentais.

O projeto proíbe, por exemplo, que o poder público crie sistemas que classifiquem ou ranqueiem pessoas com base no comportamento social para acesso a bens e serviços ou a políticas públicas “de forma ilegítima ou desproporcional” ou de sistemas de IA que facilite o abuso ou exploração sexual de crianças e adolescentes.

Alto risco

De acordo com o artigo 14 do projeto, são considerados sistemas de alto risco aqueles de controle de trânsito, de redes de abastecimento de água, eletricidade e “quando houver risco relevante à integridade física das pessoas”.

Também são considerados sistemas de IA de alto risco aqueles aplicados na educação e formação profissionais para determinar acesso à instituição de ensino ou de monitoramento de estudantes, além dos sistemas usados para recrutamento de trabalhadores ou para promoções no trabalho.

Sistemas de IA de “repartição de tarefas e controle e avaliação do desempenho e do comportamento das pessoas nas áreas de emprego, gestão de trabalhadores e acesso ao emprego por conta própria” também são considerados de alto risco.

Outros exemplos são sistemas de IA para avaliação de prioridades em serviços públicos essenciais, como bombeiros e assistência médica. Também são citados no texto os sistemas de inteligência artificial usados pela Justiça para investigação de crimes, ou que tenham risco para as liberdades individuais ou ao Estado Democrático de Direito.

Os sistemas de IA na área da saúde, como para auxiliar no diagnóstico e procedimentos médicos, e para o desenvolvimento de veículos autônomos em espaços públicos são outros exemplos de sistemas de alto risco de inteligência artificial listados pelo projeto.

Fonte: Agência Brasil